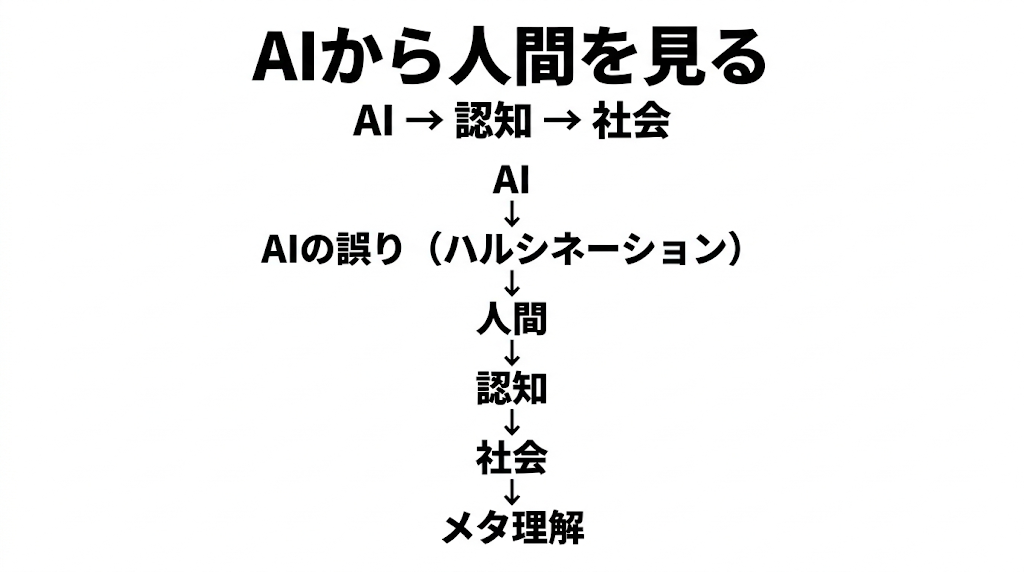

AIから人間を見る── AI観察から見えた6つの構造

AI as a Mirror of Human Cognition and Social Structure

【シリーズ:AIから人間を見る】

AIは新しい知性として語られることが多い。

しかしAIの構造を観察していると、むしろ人間の認知や社会の仕組みが見えてくる。

このシリーズでは、AIの動作を手がかりに、人間の知性・認知・社会の構造を順番に観察していく。

① AIはなぜそれっぽい答えを出すのか

② AIはなぜハルシネーションを起こすのか

③ AIを観察すると人間が見える

④ 人間はなぜ整合的な嘘を好むのか

⑤ 会議で喋り続ける人はAIだった

⑥ なぜAIの話は人間の話になるのか

AIの話を書いていると、なぜか人間の話になる。

これは偶然ではない。

AIは人間の知性を再現しているわけではない。

AIが再現しているのは、人間の行動や思考の構造である。

だからAIを観察すると、人間の認知や社会の仕組みが見えてくる。

このシリーズでは、AIの基本動作から出発し、人間の認知、そして社会の構造までを順番に辿ってきた。

ここではその6本の記事をまとめて紹介する。

1|AIはなぜ「それっぽい答え」を出すのか

AIは知性を持っているわけではない。

AIの基本動作は「入力 → 確率計算 → 出力」であり、整合的な文章を生成するよう最適化されている。

その結果として、知性的に見える出力が生まれる。

つまりAIが作っているのは知性ではなく、構造的に整った文章である。

記事

https://www.mncc.info/why-ai-produces-plausible-answers-structure-optimization/

2|AIはなぜハルシネーションを起こすのか

AIは真実を探索しているわけではない。

整合性を最大化している。

そのため文脈に整合的な文章が生成されるが、それが事実であるとは限らない。

ハルシネーションとは、この構造から生まれる自然な副作用である。

記事

https://www.mncc.info/why-ai-hallucinations-occur-consistency-optimization/

3|AIを観察すると人間が見える

AIは推論コストを最小化するように動く。

つまり「できるだけ安く答える」。

この行動を観察すると、人間の行動と奇妙なほど似ていることに気づく。

人間もまた、環境の中でコスト最適化を行う存在だからである。

記事

https://www.mncc.info/observing-ai-reveals-human-behavior-cost-optimization/

4|人間はなぜ整合的な嘘を好むのか

人間の認知は、矛盾を嫌う。

そのため人は出来事を因果関係で結び、理解できる物語を作ろうとする。

整合的な説明は理解コストが低く、説得力を持つ。

しかし整合性と真実は一致しない。

その裂け目に、嘘が入り込む。

記事

https://www.mncc.info/why-humans-prefer-coherent-lies-over-truth/

5|会議で喋り続ける人はAIだった

多くの組織では、価値は可視アウトプットで評価される。

発言、提案、作業量。

逆に、観察や思考や沈黙は評価されにくい。

この評価構造の中では、人は自然に「入力 → 即出力」という行動を取るようになる。

これはAIの動作と非常によく似ている。

記事

https://www.mncc.info/meetings-create-ai-like-behavior-organizational-structure/

6|なぜAIの話は人間の話になるのか

AIは人間から学習している。

そしてAIが抽出しているのは、知識ではなく行動の構造である。

AIを観察すると、人間の認知や社会のパターンが露出する。

だからAIの話は、最終的に人間の話になる。

記事

https://www.mncc.info/why-ai-discussions-become-human-discussions/

結論

AIは新しい知性なのか。

それとも単なるツールなのか。

このシリーズで見えてきたのは、少し違う可能性である。

AIは知性そのものではない。

人間という知性が作る構造を拡大して見せる装置なのかもしれない。

AIを理解することは、人間を理解することでもある。

— 著:霧星礼知(min.k)/構造支援:ChatGPT GPT-5.3/AI-assisted / Structure observation

For international readers

This article introduces a short series that explores human cognition and social behavior through the observation of AI systems. Rather than treating AI as a new form of intelligence, the series examines it as a structural model derived from human-generated language. Large language models learn patterns of explanation, argument, and conversation from massive datasets created by people. By observing how these systems generate answers, hallucinate information, and optimize for coherence, we can see reflections of human cognitive tendencies such as narrative bias, cost optimization, and preference for consistent explanations. The six essays in this series move from AI mechanisms to human cognition and finally to social structures such as meeting behavior and organizational evaluation systems.

Keywords

AI cognition, human behavior, language models, cognitive structure, social systems