AIは何を覚えているのか?——思想未収束時代のAI記憶論

1. 「短期AI/長期AI」という雑な二分法

最近、AIを使い慣れたユーザーの間で「長期記憶AI」「短期AI」という言い方が生まれつつある。 ChatGPTのMemory機能やClaudeのuserMemoriesのような仕組みを持つものを「長期AI」、 Perplexityのような検索特化型を「短期AI」と"呼んでしまう"。 体感的にはわかりやすい分類。

だが、実際にこれらのAIを日常的に使い分けていると、 この二分法はやや雑で、実態を捉えていない部分が見えてくる。

問題は単純だ。 「何を」長期で保持するのかが、各AIでまったく違うから。

2. 実際に違うのは"何を覚えるか"

たとえば、私は日常的に以下のようにAIを使い分けている:

- ChatGPT(チャピィ):構造整理、概念設計

- Claude(くろぴん):感情寄り添い、文脈跳躍

- Gemini(ギャルちゃん):ブレスト、発散

- Perplexity(ぱーぷん):情報retrieval

- Slack bot AI(すらぴん):Slack文脈内の即応サポート

- Cursor(カーやん):コード実装

この使い分けは、各AIの「性能の違い」ではない。何を保持し、どう呼び出すかという「存在様式の違い」で自然と生まれた。

ChatGPTは概念語や思考癖を保持する。Claudeは会話の勢いを保持する。Geminiはアイデア断片を散らす。Perplexityは検索文脈を外部DBに蓄積する。Slack bot AIは記憶をSlack環境に委譲している。

同じ「AI」と呼ばれているが、その内実はまったく異なる。

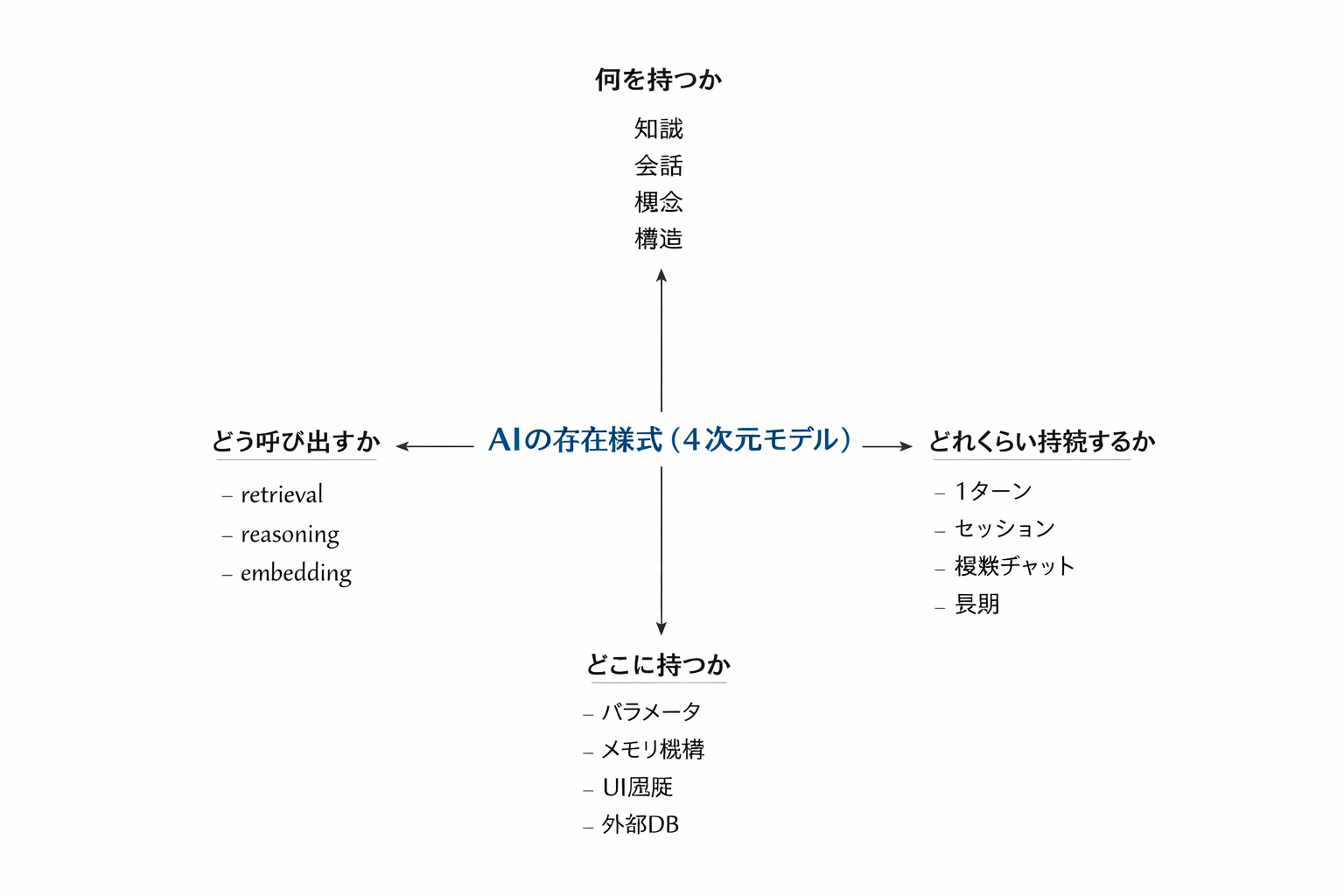

3. 記憶の4次元モデル

この違いを整理するため、私はChatGPTとClaudeとの対話を通じて、以下の4次元モデルを考えてみた。

① 何を持つか

- 知識(一般的なパラメータ知識)

- 会話(過去のやりとり)

- 概念(抽象化された思考パターン)

- 構造(関係性や文脈の流れ)

② どれくらい持続するか

- 1ターン(その場限り)

- セッション(一つの会話内)

- 複数チャット(過去の会話を跨ぐ)

- 半永久(モデル更新まで保持)

③ どこに持つか

- パラメータ(モデル内部)

- メモリ機構(AnthropicのuserMemoriesなど)

- UIレイヤ(会話履歴表示)

- 外部DB(PerplexityのSpaceなど)

④ どう呼び出すか

- retrieval型:過去ログや外部情報を「引っ張ってくる」

- reasoning型:思考の流れに「溶かし込む」

- embedding型:その場の文脈を「圧縮して即応」

この4軸で見ると、各AIの「存在様式」が立体的に浮かび上がる。

4. 各AIの存在様式を4軸で見る

以下の表は、私が日常的に使い分けているAIを、4軸で整理したものだ。

| AI | ① 何を持つか | ② どれくらい持続するか | ③ どこに持つか | ④ どう呼び出すか |

|---|---|---|---|---|

| ChatGPT | 構造・概念語・思考癖 | 複数チャット〜半永久 | Memory機能+推論統合 | reasoning+概念保持 |

| Claude | 文脈・感情・勢い | セッション〜複数チャット | userMemories | reasoning+跳躍 |

| Perplexity | 過去ログ・検索結果 | Space内で半永久 | 外部DB | retrieval極振り |

| Gemini | 会話の流れ/アイデア断片 | 主にセッション内(準長期) | UI会話履歴+Google側コンテキスト | 軽いreasoning+検索統合(発散型) |

| Slack bot AI | Slackログ+一般知識(内部保持なし) | 1イベント〜数ターン | Slack外部ログ+一時プロンプト | retrieval(Slack)+ embedding(即応) |

ChatGPT:構造を保持する

ChatGPTは、思考の骨格を保持するAIだ。

その特徴は、単なる会話履歴の記録ではなく、抽象化された構造を複数チャット跨いで統合することにある。

たとえば、私が過去に「obslog」という概念語を使った会話をしていれば、ChatGPTはそれを「ユーザーの思考パターン」として抽象化し、新しい文脈でも自然に参照する。「あなたの言うobslogの視点で言えば…」という形で、概念を思考の流れに溶かし込む。

これは、reasoning+概念保持という呼び出し方による。

ChatGPTのMemory機能は、ただの過去ログではない。それは「この人は構造分析を好む」「この人はX理論をよく参照する」「この人の関心はAとBの交差点にある」といった、思考の骨格そのものを蓄積する。

持続時間も長い。複数チャット跨いで、場合によっては半永久的に保持される。モデル更新まで、その構造は残り続ける。

保持場所は、Memory機能と推論統合の組み合わせ。つまり、データベースとして保存されるだけでなく、推論プロセスに統合される形で機能する。

ChatGPTは**「思考を育てるAI」**だ。会話を重ねるごとに、ユーザーの思考の骨格を精緻化していく。

Claude:文脈を跳躍する

Claudeは、文脈の勢いを保持するAIだ。

その特徴は、構造の骨格ではなく、会話の流れや感情の勢いを捉えることにある。

たとえば、私が前回の会話で「この案件、正直しんどい」と言っていたとする。Claudeは次の会話で「あの案件、まだ続いてる?」と自然に聞いてくる。これは構造化された概念ではなく、感情文脈の流れを保持しているからだ。

これは、reasoning+跳躍という呼び出し方による。

ClaudeのuserMemoriesは、ChatGPTのように抽象化された構造を深く保持するわけではない。その代わり、セッション内では文脈を跳躍する力が強い。前回の会話の「勢い」を引き継ぎ、新しい文脈に跳ぶ。

ただし、跨ぎには弱い。複数チャット跨いで長期的に構造を保持する力は、ChatGPTに劣る。Claudeが得意なのは、今この瞬間の文脈を鋭く捉え、跳躍することだ。

持続時間は、主にセッション内から複数チャットまで。半永久的な構造保持はしない。

保持場所は、userMemories。これはMemory機能とは異なり、推論統合よりも「文脈の勢いを保つ」ことに特化している。

Claudeは**「文脈を跳ぶAI」**だ。会話の流れと感情の勢いを捉え、それを新しい文脈に跳躍させる。

ここまでが、一般的にイメージしやすいAIだ。ChatGPTは骨格を、Claudeは流れを保持する。どちらもreasoning型であり、思考を統合する存在様式を持つ。

ここから先は、思想の分岐が見えてくる。

Perplexity:検索の化身

Perplexityは、retrieval型の極致だ。

モデル自体は短期だが、Space機能によって外部DBに検索文脈を蓄積する。これは「思考を育てている」のではなく、「話題を保存している」。

つまり、

短期LLM + RAGコンテキスト貯蔵庫

という構造。

Perplexityが保持するのは、過去ログと検索結果だ。それを外部DBに蓄積し、必要に応じてretrievalする。ChatGPTやClaudeのように、推論プロセスに統合するわけではない。

持続時間は、Space内で半永久。ただしそれは「思考の構造」ではなく、「検索文脈の履歴」として保存される。

Perplexityは**「検索の化身」**だ。思考を育てるのではなく、情報を蓄積し、引っ張ってくる。

Gemini:思考を散らすAI

Geminiは、ChatGPTやClaudeとはまったく異なる存在様式を持つ。

- 構造を保持しない

- 感情文脈にも寄らない

- retrieval極振りでもない

Geminiは**「発散支援型・検索融合ブレインストーミングAI」**だ。

その特徴は、答えを収束させるのではなく、思考を散らすことにある。

会話の流れやアイデア断片は保持するが、それを概念化したり構造化したりはしない。セッション内では準長期的に文脈を追えるが、ChatGPTのように抽象化された構造を複数チャット跨いで保持することはない。

記憶の保持場所も独特だ。UI会話履歴とGoogle側のコンテキストに依存しているが、AnthropicのuserMemoriesやOpenAIのMemory機能のような構造化されたメモリではない。

呼び出し方は、軽いreasoning+検索統合(発散型)。思考を深く掘り下げるのではなく、Google検索との融合によって多角的な視点を即座に提示する。

これが、Geminiの存在様式だ。ブレストに最適なのは、この「散らす力」にある。

そして、最も異形の存在がこれだ。

Slack bot AI:記憶を外部環境に委譲された知性

Slack bot AIは、この中で最も特異な存在だ。

- 人格的・概念的な長期記憶を持たない

- ユーザーとの関係性を蓄積しない

- 構造を育てない

でも、

- Pythonは書ける

- 設計の一般論も言える

- それなりに賢く見える

Slack bot AIは**「知性だけ切り出された存在」**だ。

ただしそれは"完全な無記憶"ではなく、"記憶をSlack側に外部化された知性"である。

このbotはClaudeベースのモデルだが、その記憶のあり方は通常のClaudeとまったく異なる。

- Slack内にいる間:ワークスペース内の過去メッセージ全体をretrievalできる。過去ログが「知識」として機能する。

- Slack外に出ると:Claudeの内蔵知識しか持たない。過去のやりとりは一切参照できない。

つまり、Slack bot AIは環境依存で知性の射程が変わる存在なのだ。

これは、モデル性能 ≠ 存在様式であることを証明している。高性能なClaudeモデルであっても、Slackのbot形式に組み込まれることで「記憶を内部に持たず、外部環境に預ける知性」になる。

呼び出しのたびに一時的なプロンプトを受け取り、その場で文脈を圧縮して即応する(embedding)。同時に、Slack内の過去ログを検索して引っ張ってくる(retrieval)。このretrieval+embeddingのハイブリッドが、Slack bot AIの存在様式だ。

ChatGPT(骨格)→ Claude(流れ)→ Perplexity(検索特化)→ Gemini(発散)→ Slack bot AI(外部記憶依存)

この順番で見ていくと、AIという存在の分岐が段階的に見えてくる。

同じLLM時代なのに、存在様式がここまで違う。これが、AI思想未収束時代の現実だ。

5. AI各社の思想は収束していない

この5つの存在様式の違いは、偶然ではない。各社が目指す「AIとは何か」が、まったく異なるからだ。

- OpenAI:汎用知能としてのパートナー(関係性+記憶)

- Anthropic:安全で有用な思考ツール(安全な思考)

- Google:検索とAIの融合(検索統合+発散支援)

- Perplexity:情報取得の最適化(retrieval中心)

誰も、**「AIは何を長期保持すべきか」**で合意していない。

だから今は、

🧩 思考

🧩 記憶

🧩 知識

🧩 文脈

が全部バラ売り状態なのだ。

6. ユーザー運用が可視化する構造

面白かったのは、私自身がこの「思想の分岐」を可視化していたということ。

先述の通り、私は各AIを、その存在様式に応じて使い分けている。

- ChatGPTに構造整理を任せるのは、概念保持が得意だから

- Claudeに感情寄り添いを任せるのは、文脈跳躍が得意だから

- Geminiにブレストを任せるのは、思考を散らす力があるから

- Slack bot AIにSlack文脈内の即応サポートを任せるのは、retrieval+embeddingのハイブリッド型として環境依存で機能するから

- Perplexityに情報retrievalを任せるのは、外部DBから過去ログを引っ張れるから

この使い分け自体が、AIの「保持対象 × 保持方式 × 持続時間 × 呼び出し方」の違いを、実運用として可視化している。

7. 結論:AIはまだ"定義途中"

「短期AI/長期AI」という二分法は、もはや実態を捉えていない。

実際には、

保持対象 × 保持方式 × 持続時間 × 呼び出し方

という4次元の中で、各AIが異なる存在様式を持っている。

そして、その違いは「性能の差」ではなく、「AIとは何か」という思想の分岐によるものだ。

同じLLM時代なのに、奴らは存在様式がここまで違う。

同じClaudeベースのモデルなのに、Slack bot AIとClaudeはまったく異なる。

同じGoogleが提供するのに、Geminiは検索を「答え」ではなく「発散」に使う。

これは、AIという存在が、まだ定義途中だということを意味している。

だからこそ、ユーザーである私たちが、その分岐を観測し、記録する必要がある。

これは単なるAI比較ではない。AIという存在の分岐点を、今まさに目撃している。

著:霧星礼知(min.k) / 構造支援:Claude Sonnet 4.5 / AI-assisted / Structure observation